Конкурентність у Go: Горутини та Канали - Повний Посібник

Опануйте конкурентність у Go з горутинами та каналами. Просунуті патерни, синхронізація, інструкції select та найкращі практики з докладними прикладами коду.

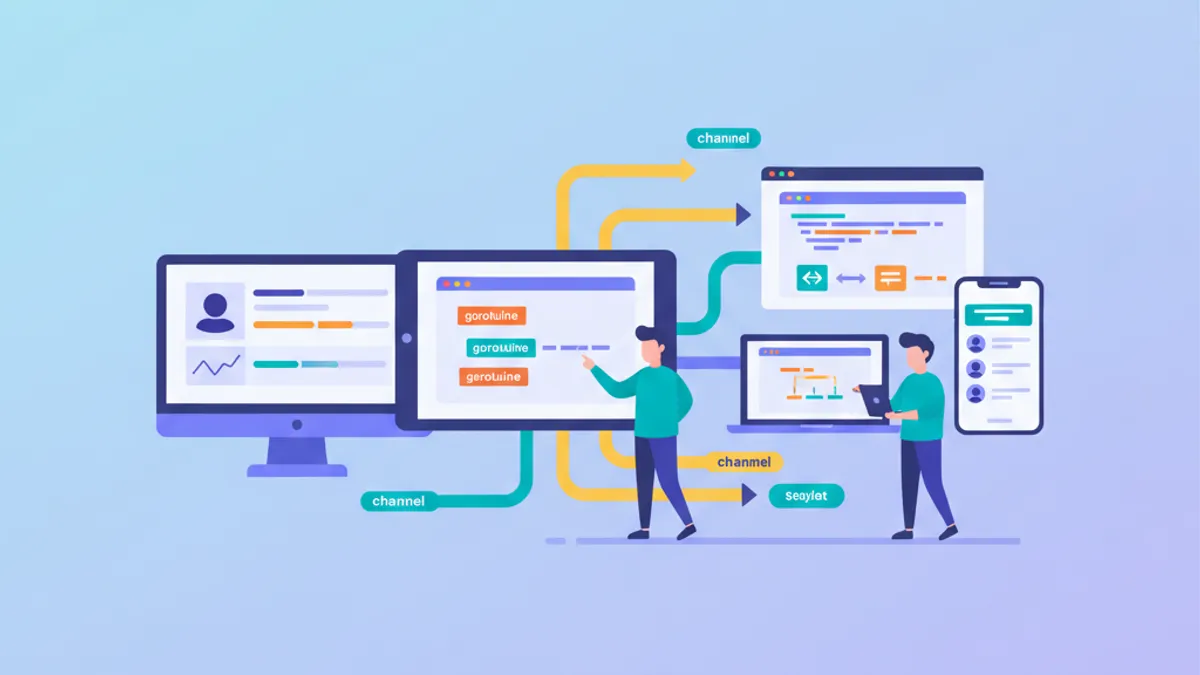

Конкурентність є однією з найбільших переваг Go. На відміну від інших мов, де багатопотоковість залишається складною, Go пропонує елегантну модель на основі горутин та каналів, яка значно спрощує розробку конкурентних застосунків.

"Не спілкуйтеся, поділяючи пам'ять; поділяйте пам'ять, спілкуючись." Цей фундаментальний принцип керує всім дизайном конкурентності в Go.

Розуміння Горутин

Горутини - це легковагові потоки, керовані середовищем виконання Go. Вони споживають близько 2 КБ стека (порівняно з кількома МБ для потоків ОС) і дозволяють виконувати тисячі конкурентних завдань без перевантаження системи.

Запуск горутини потребує лише розміщення ключового слова go перед викликом функції. Середовище виконання займається плануванням та розподілом між доступними потоками.

package main

import (

"fmt"

"time"

)

// fetchData simulates a network request

func fetchData(id int) {

// Simulates network delay

time.Sleep(100 * time.Millisecond)

fmt.Printf("Data %d fetched\n", id)

}

func main() {

// Sequential execution - 500ms total

start := time.Now()

for i := 1; i <= 5; i++ {

fetchData(i)

}

fmt.Printf("Sequential: %v\n", time.Since(start))

// Concurrent execution - ~100ms total

start = time.Now()

for i := 1; i <= 5; i++ {

go fetchData(i) // Execute as goroutine

}

time.Sleep(150 * time.Millisecond) // Wait for completion

fmt.Printf("Concurrent: %v\n", time.Since(start))

}Конкурентне виконання зменшує загальний час з 500 мс до приблизно 100 мс. Однак використання time.Sleep для синхронізації горутин не є хорошою практикою. Канали пропонують елегантне рішення.

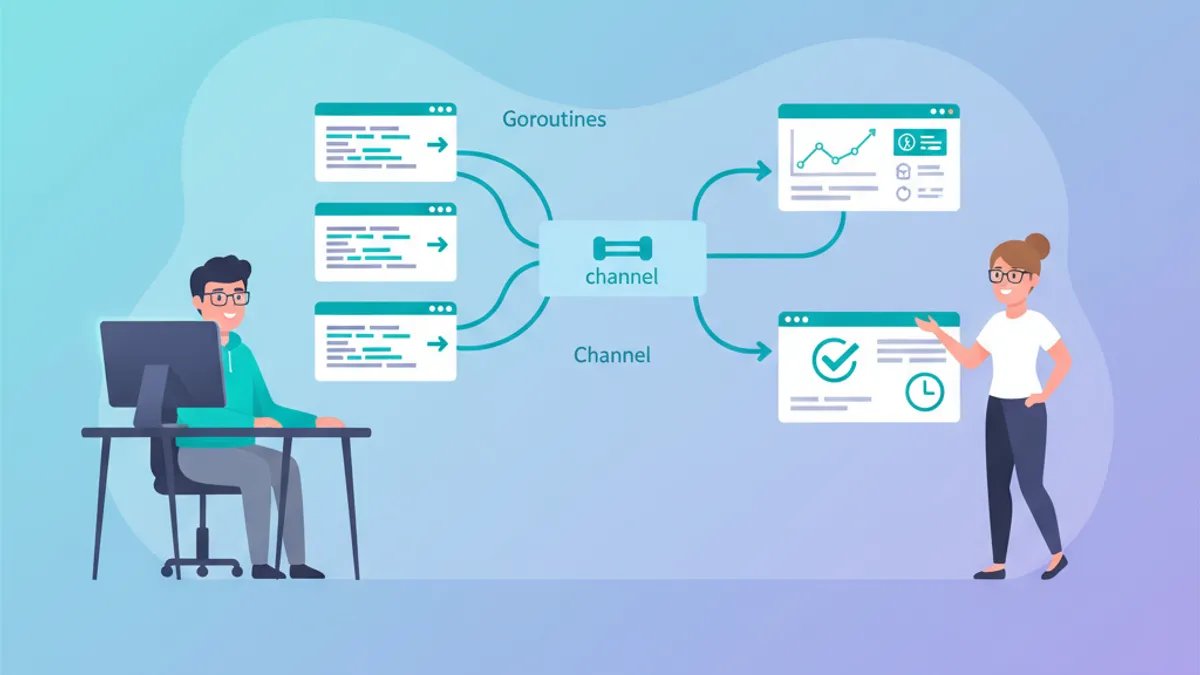

Канали: Комунікація Між Горутинами

Канал - це типізований провідник для надсилання та отримання значень між горутинами. Канали гарантують синхронізацію: горутина-відправник чекає, поки інша отримає, і навпаки.

Створення каналу використовує функцію make. Оператор <- надсилає та отримує дані залежно від його позиції відносно каналу.

package main

import "fmt"

// worker performs computation and returns result via channel

func worker(id int, jobs <-chan int, results chan<- int) {

// Receives jobs until channel closes

for job := range jobs {

result := job * 2 // Processing

results <- result // Send result

}

}

func main() {

// Create channels

jobs := make(chan int, 10) // Buffered channel

results := make(chan int, 10)

// Start 3 workers

for w := 1; w <= 3; w++ {

go worker(w, jobs, results)

}

// Send 5 jobs

for j := 1; j <= 5; j++ {

jobs <- j

}

close(jobs) // Signal end of jobs

// Collect results

for r := 1; r <= 5; r++ {

result := <-results

fmt.Printf("Result: %d\n", result)

}

}Спрямовані канали (<-chan для отримання, chan<- для надсилання) посилюють безпеку коду, обмежуючи можливі операції.

Буферизовані vs Небуферизовані Канали

Різниця між цими типами каналів безпосередньо впливає на поведінку синхронізації між горутинами.

Небуферизовані канали блокують відправника, доки одержувач не буде готовий. Буферизовані канали дозволяють надсилати до N значень без блокування, де N представляє ємність буфера.

package main

import "fmt"

func main() {

// Unbuffered channel - strict synchronization

unbuffered := make(chan string)

go func() {

unbuffered <- "message" // Blocks until received

}()

msg := <-unbuffered // Unblocks the send

fmt.Println(msg)

// Buffered channel - capacity of 2

buffered := make(chan int, 2)

// These sends don't block

buffered <- 1

buffered <- 2

// buffered <- 3 // Would block because buffer is full

fmt.Println(<-buffered) // 1

fmt.Println(<-buffered) // 2

// Check capacity

fmt.Printf("Length: %d, Capacity: %d\n",

len(buffered), cap(buffered))

}Буферизовані канали роз'єднують виробників та споживачів, тоді як небуферизовані гарантують синхронізацію точка-в-точку.

Дедлок виникає, коли всі горутини заблоковані в очікуванні. Середовище виконання Go виявляє це та завершує програму з явним повідомленням про помилку.

Select: Мультиплексування Каналів

Інструкція select чекає одночасних операцій на кількох каналах. Вона нагадує інструкцію switch для конкурентних комунікацій.

Ця конструкція є необхідною для управління таймаутами, скасуваннями та множинними комунікаціями без нескінченного блокування на одному каналі.

package main

import (

"fmt"

"time"

)

// fetchAPI simulates an API call with variable delay

func fetchAPI(name string, delay time.Duration, ch chan<- string) {

time.Sleep(delay)

ch <- fmt.Sprintf("%s: data received", name)

}

func main() {

api1 := make(chan string)

api2 := make(chan string)

// Launch two API calls in parallel

go fetchAPI("API-1", 100*time.Millisecond, api1)

go fetchAPI("API-2", 200*time.Millisecond, api2)

// Global timeout of 150ms

timeout := time.After(150 * time.Millisecond)

// Collect results with timeout

for i := 0; i < 2; i++ {

select {

case result := <-api1:

fmt.Println(result)

case result := <-api2:

fmt.Println(result)

case <-timeout:

fmt.Println("Timeout - operation cancelled")

return

}

}

}select обирає перший доступний канал. Якщо кілька готові, вибір є псевдовипадковим, щоб уникнути голодування.

Готовий до співбесід з Go?

Практикуйся з нашими інтерактивними симуляторами, flashcards та технічними тестами.

Патерн Worker Pool

Патерн worker pool розподіляє завдання між кількома воркерами, обмежуючи конкурентність та оптимізуючи використання ресурсів. Цей патерн є незамінним для обробки великих обсягів даних.

Реалізація базується на каналі завдань, спільному для воркерів, та каналі результатів для збирання.

package main

import (

"fmt"

"sync"

"time"

)

// Task represents a unit of work

type Task struct {

ID int

Data string

}

// Result contains the processing result

type Result struct {

TaskID int

Output string

}

// worker processes received tasks

func worker(id int, tasks <-chan Task, results chan<- Result, wg *sync.WaitGroup) {

defer wg.Done()

for task := range tasks {

// Simulate processing

time.Sleep(50 * time.Millisecond)

results <- Result{

TaskID: task.ID,

Output: fmt.Sprintf("Worker %d processed: %s", id, task.Data),

}

}

}

func main() {

const numWorkers = 3

const numTasks = 10

tasks := make(chan Task, numTasks)

results := make(chan Result, numTasks)

var wg sync.WaitGroup

// Start workers

for w := 1; w <= numWorkers; w++ {

wg.Add(1)

go worker(w, tasks, results, &wg)

}

// Send tasks

for i := 1; i <= numTasks; i++ {

tasks <- Task{ID: i, Data: fmt.Sprintf("task-%d", i)}

}

close(tasks)

// Close results channel after workers finish

go func() {

wg.Wait()

close(results)

}()

// Collect results

for result := range results {

fmt.Printf("Task %d: %s\n", result.TaskID, result.Output)

}

}sync.WaitGroup координує очікування завершення всіх воркерів перед закриттям каналу результатів.

Патерн Fan-Out/Fan-In

Цей патерн розподіляє роботу між кількома горутинами (fan-out), а потім агрегує результати (fan-in). Він максимізує паралелізм, спрощуючи збір результатів.

package main

import (

"fmt"

"sync"

)

// generate produces numbers on a channel

func generate(nums ...int) <-chan int {

out := make(chan int)

go func() {

for _, n := range nums {

out <- n

}

close(out)

}()

return out

}

// square computes the square of received numbers

func square(in <-chan int) <-chan int {

out := make(chan int)

go func() {

for n := range in {

out <- n * n

}

close(out)

}()

return out

}

// merge combines multiple channels into one (fan-in)

func merge(channels ...<-chan int) <-chan int {

out := make(chan int)

var wg sync.WaitGroup

// Output function for each channel

output := func(c <-chan int) {

defer wg.Done()

for n := range c {

out <- n

}

}

// Launch a goroutine per channel

wg.Add(len(channels))

for _, c := range channels {

go output(c)

}

// Close after all goroutines finish

go func() {

wg.Wait()

close(out)

}()

return out

}

func main() {

// Generate data

numbers := generate(1, 2, 3, 4, 5, 6, 7, 8)

// Fan-out: distribute to 3 workers

sq1 := square(numbers)

sq2 := square(numbers)

sq3 := square(numbers)

// Fan-in: aggregate results

for result := range merge(sq1, sq2, sq3) {

fmt.Println(result)

}

}Цей патерн чудово підходить для розподілених CPU-обмежених операцій та конвеєрів обробки даних.

Context для Скасування та Дедлайнів

Пакет context стандартизує управління скасуваннями, дедлайнами та значеннями між горутинами. Будь-яка довготривала горутина повинна приймати context як перший параметр.

package main

import (

"context"

"fmt"

"time"

)

// fetchWithContext simulates a cancellable request

func fetchWithContext(ctx context.Context, url string) (string, error) {

// Simulates a long operation

select {

case <-time.After(2 * time.Second):

return fmt.Sprintf("Data from %s", url), nil

case <-ctx.Done():

return "", ctx.Err() // context.Canceled or context.DeadlineExceeded

}

}

func main() {

// Context with 500ms timeout

ctx, cancel := context.WithTimeout(context.Background(), 500*time.Millisecond)

defer cancel() // Release resources

result, err := fetchWithContext(ctx, "https://api.example.com")

if err != nil {

fmt.Printf("Error: %v\n", err)

return

}

fmt.Println(result)

// Context with manual cancellation

ctx2, cancel2 := context.WithCancel(context.Background())

go func() {

time.Sleep(100 * time.Millisecond)

cancel2() // Explicit cancellation

}()

result, err = fetchWithContext(ctx2, "https://api2.example.com")

if err != nil {

fmt.Printf("Request cancelled: %v\n", err)

}

}Завжди викликайте defer cancel() одразу після створення context, щоб уникнути витоків ресурсів.

Синхронізація з sync.Mutex

Хоча канали є кращими для комунікації, пакет sync залишається необхідним для захисту конкурентного доступу до спільних структур даних.

package main

import (

"fmt"

"sync"

)

// SafeCounter is a thread-safe counter

type SafeCounter struct {

mu sync.Mutex

value map[string]int

}

// Increment increments the value for a given key

func (c *SafeCounter) Increment(key string) {

c.mu.Lock() // Exclusive lock

defer c.mu.Unlock() // Guaranteed unlock

c.value[key]++

}

// Value returns the current value

func (c *SafeCounter) Value(key string) int {

c.mu.Lock()

defer c.mu.Unlock()

return c.value[key]

}

func main() {

counter := SafeCounter{value: make(map[string]int)}

var wg sync.WaitGroup

// 1000 concurrent increments

for i := 0; i < 1000; i++ {

wg.Add(1)

go func() {

defer wg.Done()

counter.Increment("visits")

}()

}

wg.Wait()

fmt.Printf("Total: %d\n", counter.Value("visits")) // 1000

}sync.RWMutex оптимізує конкурентні читання з RLock()/RUnlock() для операцій тільки для читання.

Поширені Помилки та Рішення

Конкурентність у Go має класичні пастки. Ось найпоширеніші помилки та як їх уникати.

package main

import (

"fmt"

"sync"

)

func main() {

// ERROR: Loop variable capture

// All goroutines would print the same value

for i := 0; i < 3; i++ {

go func() {

fmt.Println(i) // Capture by reference - BUG

}()

}

// SOLUTION: Pass value as parameter

var wg sync.WaitGroup

for i := 0; i < 3; i++ {

wg.Add(1)

go func(n int) {

defer wg.Done()

fmt.Println(n) // Local copy - CORRECT

}(i)

}

wg.Wait()

// ERROR: Send on nil channel

var ch chan int

// ch <- 1 // Blocks forever

// SOLUTION: Always initialize with make

ch = make(chan int, 1)

ch <- 1

fmt.Println(<-ch)

// ERROR: Send on closed channel

done := make(chan bool)

close(done)

// done <- true // Panic!

// SOLUTION: Check before send or use sync.Once

select {

case done <- true:

fmt.Println("Sent")

default:

fmt.Println("Channel closed or full")

}

}Виявлення race condition використовує прапор -race під час компіляції або тестування: go test -race ./....

Починай практикувати!

Перевір свої знання з нашими симуляторами співбесід та технічними тестами.

Висновок

Опанування конкурентності у Go ґрунтується на кількох ключових концепціях, які при правильному розумінні дозволяють створювати високопродуктивні застосунки.

Ключові моменти:

✅ Горутини є легковаговими та дешевими - створення тисяч залишається прийнятним

✅ Канали синхронізують та передають дані між горутинами

✅ Інструкція select керує множинними комунікаціями та таймаутами

✅ Патерн worker pool обмежує конкурентність та оптимізує ресурси

✅ Пакет context стандартизує скасування та дедлайни

✅ М'ютекси захищають спільні дані, коли каналів недостатньо

✅ Прапор -race виявляє race condition під час тестів

Філософія "Поділяти пам'ять, спілкуючись" веде до більш безпечних та підтримуваних дизайнів, ніж традиційна багатопотоковість з блокуваннями.

Теги

Поділитися

Пов'язані статті

Tekhnichna spivbesida z Go: Goroutines, Channels ta Concurrency

Pytannia na spivbesidi z Go shchodo goroutines, channels ta paterniw konkurentnosti. Pryklady kodu, typowi pastky ta ekspertni widpovidi dlia pidhotovky do tekhnichnykh spivbesid z Go u 2026 rotsi.

Топ 25 запитань на співбесіду з Go: повний посібник для розробника

Підкорюйте співбесіди з Go завдяки 25 найпоширенішим запитанням. Горутини, канали, інтерфейси та патерни конкурентності з прикладами коду.

Go: Основи для Java/Python-розробників у 2026 році

Швидке вивчення Go з використанням досвіду Java або Python. Goroutines, channels, інтерфейси та основні патерни для плавного переходу.