Async/Await in Rust: Tokio, Future e concorrenza asincrona spiegati

Guida approfondita a Rust async/await con runtime Tokio, trait Future, spawning dei task, concorrenza strutturata e pattern reali per applicazioni asincrone ad alte prestazioni.

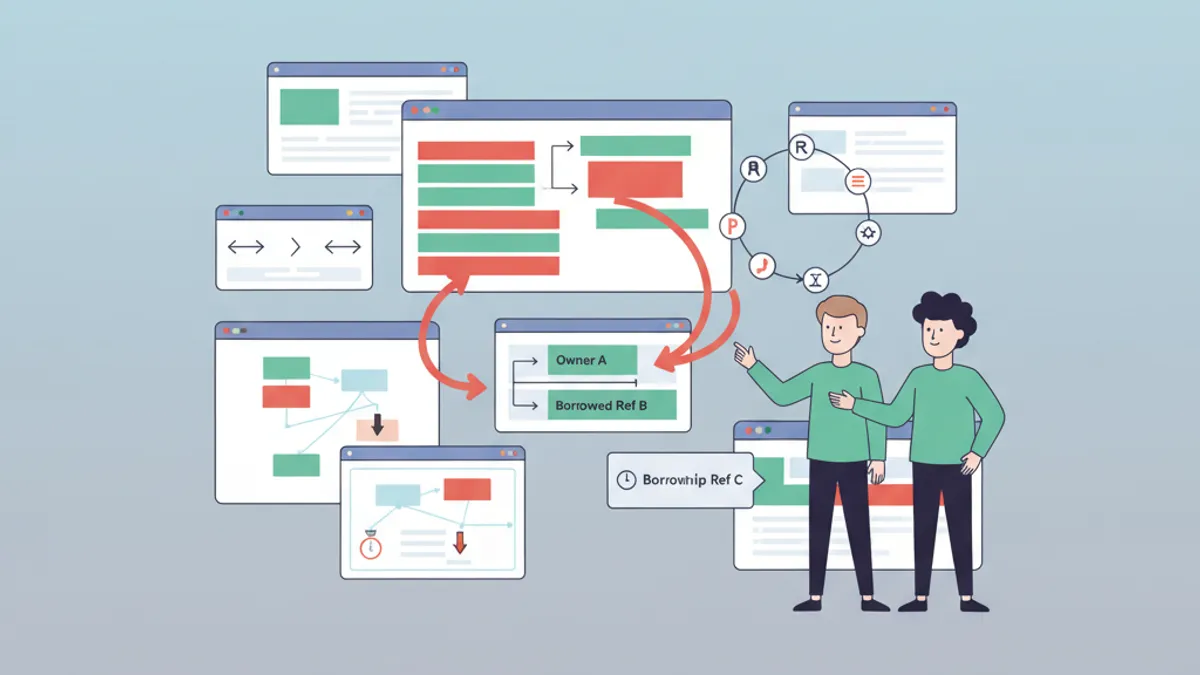

Rust ha rivoluzionato il modo in cui gli sviluppatori affrontano la programmazione asincrona, introducendo un modello basato su zero-cost abstractions che combina la sicurezza della memoria con prestazioni comparabili al C++. A differenza di linguaggi come JavaScript o Python, dove l'asincronicità è gestita tramite runtime integrati, Rust adotta un approccio più radicale: i Future sono costrutti lazy che non eseguono alcuna operazione finché non vengono attivamente interrogati da un runtime asincrono come Tokio. Questo design permette di costruire applicazioni concurrent altamente efficienti senza garbage collector, eliminando al contempo le classiche race condition grazie al sistema di ownership. La comprensione profonda di async/await, Future e delle primitive di concorrenza di Tokio è fondamentale per sfruttare appieno il potenziale del linguaggio in scenari che spaziano dai web server ai sistemi distribuiti.

I Future in Rust non iniziano l'esecuzione automaticamente. Devono essere esplicitamente awaited o passati a un executor come Tokio. Questo approccio lazy elimina il lavoro inutile e garantisce controllo totale sul flusso di esecuzione.

Come i Future di Rust differiscono dagli altri linguaggi

Il trait Future rappresenta il cuore della programmazione asincrona in Rust. A differenza delle Promise di JavaScript o delle coroutine di Python, un Future in Rust è un tipo che implementa un trait specifico con un metodo poll:

// core::future::Future

trait Future {

type Output;

fn poll(self: Pin<&mut Self>, cx: &mut Context<'_>) -> Poll<Self::Output>;

}Questo design presenta caratteristiche distintive. Ogni Future possiede un tipo Output associato che rappresenta il valore restituito una volta completato. Il metodo poll viene invocato ripetutamente dall'executor: restituisce Poll::Pending se il lavoro non è ancora completato, oppure Poll::Ready(value) quando il risultato è disponibile. Il parametro Context fornisce un meccanismo di wakeup che permette al Future di notificare l'executor quando è pronto per essere interrogato nuovamente.

La differenza cruciale rispetto ad altri ecosistemi è che i Future di Rust sono inerti: creare un Future non avvia alcuna computazione. Solo quando un executor chiama poll il lavoro procede. Questo comportamento elimina automaticamente problemi come le Promise non gestite di JavaScript, poiché un Future ignorato semplicemente non esegue mai.

Il compilatore trasforma ogni funzione async in una state machine che implementa Future. Quando si scrive async fn fetch_data(), Rust genera automaticamente un tipo anonimo che traccia lo stato di esecuzione attraverso ogni punto di await. Questa trasformazione avviene a compile-time, senza overhead a runtime: il risultato è codice macchina altamente ottimizzato privo di allocazioni heap superflue.

Configurazione di Tokio come runtime asincrono

Rust non fornisce un runtime asincrono nella libreria standard. Gli sviluppatori devono scegliere un executor esterno, e Tokio è diventato lo standard de facto per applicazioni production-grade. Tokio offre un runtime multi-threaded, primitive di sincronizzazione asincrone, timer, I/O networking e molto altro.

Per integrare Tokio in un progetto, si aggiunge la dipendenza in Cargo.toml specificando le feature necessarie:

# Cargo.toml

[dependencies]

tokio = { version = "2", features = ["rt-multi-thread", "macros", "net", "time"] }Le feature abilitate includono rt-multi-thread per il runtime con thread pool, macros per attributi come #[tokio::main], net per socket TCP/UDP asincroni, e time per operazioni basate su timer. Tokio adotta un approccio modulare: attivare solo le feature necessarie riduce i tempi di compilazione e la dimensione del binario finale.

Il macro #[tokio::main] trasforma la funzione main sincrona in un entry point asincrono, configurando automaticamente il runtime:

#[tokio::main]

async fn main() {

let result = fetch_data().await;

println!("Got: {result}");

}

async fn fetch_data() -> String {

// Simulate async I/O

tokio::time::sleep(std::time::Duration::from_millis(100)).await;

String::from("data loaded")

}Dietro le quinte, #[tokio::main] espande il codice per creare un Runtime, eseguire il corpo della funzione main asincrona, e bloccarsi fino al completamento. Il runtime gestisce un thread pool (configurabile) che esegue i task in parallelo, utilizzando un algoritmo di work-stealing per bilanciare il carico.

Tokio supporta anche runtime single-threaded (current_thread) per scenari embedded o test dove il determinismo è prioritario. La scelta del runtime influenza direttamente throughput, latenza e consumo di risorse: per server ad alto carico, rt-multi-thread offre parallelismo reale su core multipli.

Spawning dei task e concorrenza strutturata

Uno dei pattern più potenti di Tokio è tokio::spawn, che permette di eseguire task concorrenti in modo indipendente. Ogni task spawned gira sul runtime Tokio e può progredire in parallelo ad altri task:

use tokio::task::JoinHandle;

#[tokio::main]

async fn main() {

// Spawn two independent tasks

let handle_a: JoinHandle<u32> = tokio::spawn(async {

expensive_computation("dataset_a").await

});

let handle_b: JoinHandle<u32> = tokio::spawn(async {

expensive_computation("dataset_b").await

});

// Await both results

let (result_a, result_b) = (

handle_a.await.expect("task A panicked"),

handle_b.await.expect("task B panicked"),

);

println!("Results: {result_a}, {result_b}");

}

async fn expensive_computation(name: &str) -> u32 {

tokio::time::sleep(std::time::Duration::from_secs(1)).await;

println!("{name} done");

42

}L'esempio dimostra come tokio::spawn restituisce un JoinHandle<T> che funge da future per il risultato del task. I due task handle_a e handle_b eseguono concorrentemente: su un runtime multi-threaded, potrebbero girare su core fisici diversi. Awaiting gli handle raccoglie i risultati, propagando eventuali panic tramite Result.

Questo modello richiede che il Future passato a spawn sia Send + 'static. Il bound Send garantisce che il task possa essere trasferito tra thread in sicurezza, mentre 'static assicura che non contenga riferimenti borrowed con lifetime limitati. Questi vincoli proteggono da data race e use-after-free, errori comuni in linguaggi senza ownership.

Tokio richiede che ogni task spawned sia trasferibile tra thread (Send) e non contenga riferimenti borrowed ('static). Per condividere dati, utilizzare tipi thread-safe come Arc<Mutex<T>> o Arc<RwLock<T>>.

La concorrenza strutturata emerge quando i task dipendono da scope ben definiti. Cancellare il JoinHandle senza awaiting termina il task in background, ma se si desidera garantire che tutti i task completino prima di proseguire, è essenziale raccogliere esplicitamente ogni handle. Questo pattern previene task "zombie" che consumano risorse indefinitamente.

Combinare più Future con tokio::join! e tokio::select!

Tokio fornisce macro potenti per orchestrare multipli Future con semantiche diverse. tokio::join! attende il completamento di tutti i future forniti, eseguendoli concorrentemente:

use tokio::time::{sleep, Duration};

#[tokio::main]

async fn main() {

// All three run concurrently, total time ~200ms (not 600ms)

let (users, orders, inventory) = tokio::join!(

fetch_users(),

fetch_orders(),

fetch_inventory()

);

println!("Users: {}, Orders: {}, Stock: {}", users.len(), orders.len(), inventory);

}

async fn fetch_users() -> Vec<String> {

sleep(Duration::from_millis(200)).await;

vec!["Alice".into(), "Bob".into()]

}

async fn fetch_orders() -> Vec<String> {

sleep(Duration::from_millis(150)).await;

vec!["ORD-001".into()]

}

async fn fetch_inventory() -> u32 {

sleep(Duration::from_millis(100)).await;

84

}Senza join!, awaiting sequenzialmente ogni funzione richiederebbe circa 450ms. Con join!, l'esecuzione concorrente riduce il tempo totale a quello del future più lento (200ms). Questa ottimizzazione è cruciale per operazioni I/O-bound come query database o chiamate API, dove la latenza di rete domina il tempo di esecuzione.

tokio::select! offre una semantica completamente diversa: attende il primo future che completa, scartando automaticamente gli altri:

use tokio::time::{sleep, Duration};

#[tokio::main]

async fn main() {

tokio::select! {

val = fetch_from_cache() => {

println!("Cache hit: {val}");

}

val = fetch_from_database() => {

println!("DB result: {val}");

}

}

}

async fn fetch_from_cache() -> String {

sleep(Duration::from_millis(5)).await;

"cached_value".into()

}

async fn fetch_from_database() -> String {

sleep(Duration::from_millis(50)).await;

"db_value".into()

}Questo pattern è ideale per scenari con fallback: tentare di leggere da una cache veloce e, se fallisce o è troppo lenta, ricorrere a una fonte autoritativa. select! garantisce che solo il ramo vincente esegua completamente, evitando lavoro superfluo.

Entrambe le macro rispettano il sistema di ownership di Rust: se un future viene droppato (come nel caso di select! per i rami non scelti), tutte le risorse vengono rilasciate automaticamente. Questo comportamento elimina leak di memoria e resource exhaustion, problemi endemici in runtime asincroni meno rigidi.

Pronto a superare i tuoi colloqui su Rust?

Pratica con i nostri simulatori interattivi, flashcards e test tecnici.

Gestione degli errori nel Rust asincrono

Il Rust asincrono integra naturalmente il sistema di error handling basato su Result<T, E>. Le funzioni async possono restituire Result, permettendo la propagazione degli errori tramite l'operatore ?:

use std::io;

#[derive(Debug)]

enum AppError {

Network(reqwest::Error),

Parse(serde_json::Error),

Io(io::Error),

}

async fn load_config(url: &str) -> Result<Config, AppError> {

let response = reqwest::get(url)

.await

.map_err(AppError::Network)?;

let text = response.text()

.await

.map_err(AppError::Network)?;

let config: Config = serde_json::from_str(&text)

.map_err(AppError::Parse)?;

Ok(config)

}

#[derive(serde::Deserialize)]

struct Config {

db_url: String,

port: u16,

}Definire enum custom come AppError consente di rappresentare tutti i possibili fallimenti in modo type-safe. Ogni variante incapsula un tipo di errore specifico, e map_err permette conversioni esplicite. Questo approccio elimina le eccezioni unchecked tipiche di altri linguaggi, forzando il caller a gestire ogni caso di errore.

Le librerie async-aware come anyhow e thiserror semplificano ulteriormente il codice. anyhow::Result<T> fornisce un tipo di errore generico con backtrace automatici, utile per applicazioni dove il context conta più della granularità. thiserror genera implementazioni di std::error::Error tramite derive macro, riducendo il boilerplate.

Un pattern comune è combinare Result con Option per distinguere tra assenza di valore e fallimento effettivo. Ad esempio, una query database potrebbe restituire Result<Option<User>, DbError>, dove Ok(None) indica che nessun record corrisponde (caso valido), mentre Err(DbError::ConnectionLost) segnala un problema infrastrutturale che richiede retry o fallback.

Channel per la comunicazione asincrona tra task

I channel sono primitive fondamentali per coordinare task concorrenti senza shared state. Tokio fornisce mpsc (multi-producer, single-consumer), oneshot (single-value), e broadcast (multi-consumer):

use tokio::sync::mpsc;

#[tokio::main]

async fn main() {

// Bounded channel with capacity 32

let (tx, mut rx) = mpsc::channel::<String>(32);

// Producer task

let producer = tokio::spawn(async move {

for i in 0..5 {

tx.send(format!("message-{i}")).await.unwrap();

tokio::time::sleep(std::time::Duration::from_millis(10)).await;

}

// tx dropped here, closing the channel

});

// Consumer reads until channel closes

while let Some(msg) = rx.recv().await {

println!("Received: {msg}");

}

producer.await.unwrap();

}I channel bounded applicano backpressure: se il buffer è pieno, send blocca finché il consumer non consuma messaggi. Questo meccanismo previene producer troppo veloci da saturare la memoria. I channel unbounded (mpsc::unbounded_channel) eliminano il limite, ma espongono al rischio di crescita illimitata se i producer superano stabilmente i consumer.

La semantica move nei task spawned trasferisce l'ownership del sender o receiver nel task. Una volta che tutti i sender sono droppati, il channel si chiude automaticamente e recv restituisce None, segnalando al consumer di terminare. Questo pattern garantisce shutdown puliti senza segnali espliciti.

I channel oneshot sono ottimizzati per comunicazioni single-shot, dove un task invia esattamente un valore a un altro. Usati spesso per pattern request-response, i oneshot evitano l'overhead dei channel bounded quando la molteplicità non è necessaria. I channel broadcast permettono a multipli consumer di ricevere copie degli stessi messaggi, utili per eventi come configurazione reload o notifiche di sistema.

Pattern reale: richieste HTTP concorrenti con rate limiting

Applicazioni reali spesso devono bilanciare concorrenza e vincoli esterni come rate limit API. Tokio offre Semaphore per limitare il numero di task simultanei:

use std::sync::Arc;

use tokio::sync::Semaphore;

async fn fetch_all(urls: Vec<String>, max_concurrent: usize) -> Vec<Result<String, String>> {

let semaphore = Arc::new(Semaphore::new(max_concurrent));

let mut handles = Vec::new();

for url in urls {

let sem = Arc::clone(&semaphore);

let handle = tokio::spawn(async move {

// Acquire permit before making request

let _permit = sem.acquire().await.unwrap();

reqwest::get(&url)

.await

.map(|r| r.status().to_string())

.map_err(|e| e.to_string())

// permit dropped here, allowing next task to proceed

});

handles.push(handle);

}

let mut results = Vec::new();

for handle in handles {

results.push(handle.await.unwrap());

}

results

}Il Semaphore inizializzato con max_concurrent permette solo quel numero di permit attivi simultaneamente. Ogni task acquisisce un permit prima di procedere: se tutti i permit sono in uso, acquire attende finché uno diventa disponibile. Quando il permit viene droppato (automaticamente alla fine dello scope), il semaforo lo rilascia, permettendo a task in attesa di procedere.

Questo pattern è cruciale per rispettare rate limit esterni o per evitare di saturare risorse limitate come connection pool database. Combinato con tokio::time::interval per throttling temporale, si costruiscono fetcher sofisticati che massimizzano throughput rispettando vincoli.

Arc (Atomic Reference Counted) permette di condividere il Semaphore tra task spawned. A differenza di Rc, Arc usa atomic operations per il reference counting, garantendo thread-safety senza lock espliciti. Il compilatore richiede Arc per tipi condivisi tra thread, prevenendo data race a compile-time.

join!/try_join!: quando servono tutti i risultatiselect!: per race condition o timeoutSemaphore: limitare concorrenzaMutex/RwLock: proteggere shared state- Channel: comunicazione producer-consumer

Pin e Unpin: perché il Rust asincrono ne ha bisogno

Il tipo Pin<&mut T> appare nella firma di Future::poll e rappresenta uno degli aspetti più complessi del Rust asincrono. I Future generati da funzioni async sono self-referential: contengono puntatori interni che referenziano campi della stessa struct. Spostare in memoria queste struct invaliderebbe i puntatori, causando undefined behavior.

Pin risolve questo problema impedendo lo spostamento di un valore. Un Pin<&mut T> è un riferimento mutabile che garantisce che il valore T non verrà mai moved. Questo permette al compilatore di generare state machine sicure per i Future senza richiedere allocazioni heap aggiuntive.

La maggior parte degli sviluppatori non interagisce direttamente con Pin: i combinatori di Future e le macro async/await nascondono questa complessità. Tuttavia, implementare manualmente Future richiede comprensione di Pin. Il trait marker Unpin indica che un tipo può essere spostato anche se pinnato: la maggior parte dei tipi standard implementa Unpin, rendendo Pin trasparente per loro.

Comprendere Pin diventa essenziale quando si costruiscono abstraction di basso livello come custom executors, async stream transformer, o integration con FFI (Foreign Function Interface) che richiede garanzie di stabilità di indirizzo.

Caratteristiche prestazionali e quando usare async

Il modello asincrono di Rust eccelle in scenari I/O-bound dove il programma passa la maggior parte del tempo in attesa di risorse esterne (network, disk, database). In questi casi, l'overhead della gestione dei Future è trascurabile rispetto alla latenza dell'I/O, e la capacità di multiplexare migliaia di task su pochi thread produce throughput elevato.

Per operazioni CPU-bound, tuttavia, il codice asincrono può peggiorare le prestazioni. Un task che esegue calcoli intensivi senza await-point blocca l'executor, impedendo ad altri task di progredire. Tokio fornisce spawn_blocking per offload di lavoro CPU-intensive a thread dedicati:

#[tokio::main]

async fn main() {

let hash = tokio::task::spawn_blocking(|| {

// CPU-intensive work runs on a blocking thread

compute_hash(b"large dataset")

})

.await

.unwrap();

println!("Hash: {hash}");

}

fn compute_hash(data: &[u8]) -> String {

use std::collections::hash_map::DefaultHasher;

use std::hash::{Hash, Hasher};

let mut hasher = DefaultHasher::new();

data.hash(&mut hasher);

format!("{:x}", hasher.finish())

}spawn_blocking esegue la closure su un thread pool separato ottimizzato per operazioni bloccanti. Il risultato viene awaited come qualsiasi altro Future, mantenendo l'interfaccia uniforme. Questo pattern è essenziale per evitare di degradare la responsività dell'executor principale.

La scelta tra async e sync dipende dal workload: web server, proxy, API gateway beneficiano enormemente di async; parser, compilatori, simulazioni fisiche spesso performano meglio con parallelismo multi-thread tradizionale tramite rayon o std::thread.

Inizia a praticare!

Metti alla prova le tue conoscenze con i nostri simulatori di colloquio e test tecnici.

Conclusione

La programmazione asincrona in Rust rappresenta un equilibrio unico tra prestazioni, sicurezza e controllo. Il modello basato su Future, combinato con runtime come Tokio, permette di costruire sistemi altamente concorrenti che sfruttano appieno l'hardware moderno senza sacrificare le garanzie di memory safety. Le primitive discusse formano il toolkit essenziale per sviluppare applicazioni production-ready.

Concetti chiave:

Futuresono lazy: nessuna esecuzione avviene finché non sono awaited- Tokio gestisce lo scheduling: il runtime bilancia automaticamente task su thread multipli

- Primitive di concorrenza:

join!,select!,spawn,Semaphore, channel offrono strumenti per ogni scenario - Error handling type-safe:

Result<T, E>e?eliminano errori silenziosi Pinprotegge i self-referential struct: garantisce sicurezza senza overhead runtimespawn_blockingper CPU-bound: previene starvation dell'executor- Ownership e lifetimes prevengono race: il compilatore blocca concorrenza non sicura a compile-time

Tag

Condividi

Articoli correlati

Ownership e Borrowing in Rust: la guida completa per padroneggiare la gestione della memoria

Una guida approfondita su ownership e borrowing in Rust con esempi pratici. Move semantics, riferimenti, lifetimes e borrow checker per scrivere codice sicuro ed efficiente.

Ownership e Borrowing in Rust: Guida Completa

Padroneggia il sistema di ownership e borrowing di Rust. Regole di proprietà, riferimenti, lifetime e pattern avanzati di gestione della memoria.

Domande Colloquio Rust: Guida Completa 2026

Le 25 domande più comuni nei colloqui Rust. Ownership, borrowing, lifetimes, traits, async e concurrency con risposte dettagliate ed esempi di codice.