Go 1.26 Interview: Green Tea GC, go fix und Stack-Optimierungen im Detail

Umfassende Vorbereitung auf Go-1.26-Interviewfragen: Der neue Green Tea Garbage Collector reduziert GC-Overhead um 10-40%, das ueberarbeitete go-fix-Tool modernisiert Codebasen automatisch und Stack-allozierte Slice-Backing-Stores eliminieren Heap-Allokationen. Mit Codebeispielen und erwarteten Antworten.

Go 1.26, veroeffentlicht im Februar 2026, bringt drei Neuerungen mit sich, die das Laufzeitverhalten der Sprache grundlegend veraendern: Der Green Tea Garbage Collector ist nun der Standard-GC, das vollstaendig ueberarbeitete go fix-Tool automatisiert die Modernisierung von Codebasen, und neue Stack-Allokationsoptimierungen fuer Slices reduzieren Heap-Zugriffe erheblich. Diese Aenderungen gehoeren zu den wirkungsvollsten Runtime-Verbesserungen der letzten Go-Releases und werden in technischen Interviews zunehmend abgefragt.

Die drei Hauptfeatures: Green Tea GC (10-40% weniger GC-Overhead), ueberarbeitetes go fix mit Modernizern und Stack-allozierte Slice-Backing-Stores. Alle drei Verbesserungen wirken ohne jegliche Codeanpassung.

Was ist der Green Tea Garbage Collector in Go 1.26?

Erwartete Antwort: Green Tea ist der neue Standard-Garbage-Collector in Go 1.26 und ersetzt die bisherige Scanning-Strategie des Tri-Color-Concurrent-Collectors. Anstatt einzelne Objekte zu verfolgen, die ueber den gesamten Heap verstreut liegen (Pointer-Chasing), scannt Green Tea zusammenhaengende 8-KiB-Speicherseiten. Dieses sequenzielle Speicherzugriffsmuster ermoeglicht es dem CPU-Prefetcher, effektiv zu arbeiten, was zu einer Reduktion des GC-Overheads um 10-40% bei realen Programmen fuehrt.

Auf modernen CPUs (Intel Ice Lake oder AMD Zen 4 und neuer) nutzt der GC zusaetzlich SIMD-Vektorinstruktionen beim Scannen kleiner Objekte, was weitere rund 10% Verbesserung bringt.

Vertiefende Frage: Wie verbessert Green Tea das CPU-Cache-Verhalten waehrend der Garbage Collection?

Der bisherige GC folgte Objektpointern quer ueber den Heap, was haeufig zu Cache-Misses fuehrte. Green Tea verarbeitet Objekte stattdessen seitenweise in zusammenhaengenden 8-KiB-Bloecken. Der CPU-Prefetcher kann sequenzielle Speicherzugriffsmuster vorhersagen und haelt die L1/L2-Caches warm. Diese Verbesserung der Speicherlokalitaet ist der primaere Treiber hinter der 10-40%-Reduktion des Overheads.

// Previous approach: follow pointers across heap

func scanObject(obj *mspan) {

for _, ptr := range obj.pointers {

markReachable(ptr) // cache miss likely

}

}

// Green Tea approach: scan contiguous pages

func scanPage(page *pageBlock) {

// Sequential 8 KiB scan - CPU prefetcher friendly

for offset := 0; offset < pageSize; offset += objSize {

scanSlot(page.base + offset) // cache hit likely

}

}Green Tea kann mit GOEXPERIMENT=nogreenteagc zur Build-Zeit deaktiviert werden, allerdings wird diese Opt-out-Moeglichkeit voraussichtlich in Go 1.27 entfernt.

Wie optimiert Go 1.26 die Stack-Allokation fuer Slices?

Erwartete Antwort: Go 1.26 erweitert die Stack-Allokation auf Slice-Backing-Stores bei Append-basierter Akkumulation. Bisher allozierte der erste append-Aufruf einen Slice der Laenge 1 auf dem Heap, dann 2, dann 4, dann 8 (Standard-Verdoppelung). Go 1.26 legt vor Beginn der Schleife einen kleinen Stack-basierten Backing-Store an, sodass die ersten Append-Operationen den Stack-Buffer nutzen, ganz ohne Heap-Beteiligung.

func collectTasks(items []Item) []Task {

var tasks []Task

// Before Go 1.26: first append allocates on heap (size 1, 2, 4...)

// Go 1.26: compiler inserts a stack-backed buffer

for _, item := range items {

if item.IsReady() {

tasks = append(tasks, item.ToTask())

// First ~4 appends use stack buffer, zero heap allocations

}

}

return tasks

// If slice escapes, runtime.move2heap() copies once at return

}Vertiefende Frage: Was geschieht, wenn der Slice den Funktions-Scope verlaesst?

Selbst wenn der Slice auf den Heap wechseln muss (weil die Funktion ihn zurueckgibt), nutzt Go 1.26 waehrend der Akkumulation weiterhin den Stack-Buffer. Der Compiler fuegt einen runtime.move2heap()-Aufruf ein, der die finalen Daten genau einmal am Return-Punkt auf den Heap kopiert. Statt 3+ Startup-Heap-Allokationen (Groesse 1, 2, 4...) erfolgt exakt eine einzige Heap-Allokation am Ende. In vielen Faellen ist dies sogar besser als handoptimierte Vorab-Allokation, da die Kopie nur dann stattfindet, wenn die Daten bis zum Return-Punkt ausschliesslich Stack-basiert waren.

Was hat sich am go-fix-Tool in Go 1.26 geaendert?

Erwartete Antwort: Das go fix-Tool wurde vollstaendig neu geschrieben und dient nun als zentrale Anlaufstelle fuer Go-Modernizer. Es bietet eine einfache Moeglichkeit, Go-Codebasen auf die neuesten Idiome und Core-Library-APIs zu aktualisieren. Das neue go fix basiert auf dem gleichen Analyse-Framework wie go vet, sodass dieselben Analyzer, die Diagnosen liefern, nun auch Fixes vorschlagen und anwenden koennen.

Die wichtigsten Eigenschaften des neuen go fix:

- Dutzende von Fixern fuer moderne Go-Idiome und APIs

- Ein Source-Level-Inliner, aktivierbar durch

//go:fix inline-Direktiven - Garantiert keine Verhaltensaenderungen (sicher fuer Produktionscode)

- Veraltete Fixer aus dem alten Tool wurden entfernt

# Apply all modernizers to the current module

go fix ./...

# The tool automatically updates patterns like:

# - Old-style error wrapping to fmt.Errorf with %w

# - Deprecated API calls to their replacements

# - Legacy patterns to modern Go idiomsVertiefende Frage: Wie funktioniert //go:fix inline?

Die //go:fix inline-Direktive markiert eine Funktion oder Methode als Kandidat fuer Source-Level-Inlining durch go fix. Wenn go fix ausgefuehrt wird, ersetzt es die Aufrufstellen der annotierten Funktion durch deren Funktionskoerper. Dies unterscheidet sich vom Compiler-Inlining: Es transformiert den Quellcode, nicht den generierten Maschinencode. Bibliotheksautoren nutzen diese Technik, um Wrapper-Funktionen zu deprecaten, indem sie an der Aufrufstelle in moderne Aequivalente inline-expandiert werden.

Welche cgo-Performance-Verbesserung bringt Go 1.26?

Erwartete Antwort: Go 1.26 reduziert den Basis-Overhead jedes cgo-Aufrufs um rund 30%. Die Runtime erreicht dies durch die Eliminierung des _Psyscall-Prozessorzustands, eines Zwischenzustands, den Goroutinen waehrend cgo-Aufrufen durchliefen. Durch die Entfernung dieses Uebergangszustands sinkt die Anzahl der Zustandswechsel pro cgo-Aufruf, was die Latenz direkt reduziert.

Dies ist relevant fuer Anwendungen mit haeufigen cgo-Aufrufen, etwa Programme, die C-Bibliotheken fuer Datenbanktreiber, Bildverarbeitung oder kryptografische Operationen verwenden. Die Verbesserung erfordert keinerlei Codeanpassungen.

Welche Sprachaenderungen enthaelt Go 1.26?

Erwartete Antwort: Go 1.26 fuehrt zwei Sprachaenderungen ein:

1. Erweiterte new()-Funktion: Die eingebaute new-Funktion akzeptiert nun einen Ausdruck als Operanden, der den Initialwert der Variable festlegt. Bisher gab new(T) stets einen Zeiger auf den Nullwert von T zurueck.

type Config struct {

Timeout *int

MaxRetry *int

}

// Before Go 1.26: helper function needed

func intPtr(v int) *int { return &v }

func makeConfig() Config {

return Config{

Timeout: intPtr(30),

MaxRetry: intPtr(3),

}

}

// Go 1.26: direct initialization

func makeConfig() Config {

return Config{

Timeout: new(30), // *int pointing to 30

MaxRetry: new(3), // *int pointing to 3

}

}2. Selbstreferenzielle generische Typen: Generische Typen koennen sich nun in ihren Typparameter-Constraints selbst referenzieren, was fortgeschrittene Typabstraktionsmuster wie F-bounded Polymorphism ermoeglicht.

type Adder[A Adder[A]] interface {

Add(A) A

}

type Vector2D struct{ X, Y float64 }

func (v Vector2D) Add(other Vector2D) Vector2D {

return Vector2D{v.X + other.X, v.Y + other.Y}

}

// The constraint ensures the return type matches the receiver type

func Sum[A Adder[A]](items []A) A {

var result A

for _, item := range items {

result = result.Add(item)

}

return result

}Bereit für deine Go-Interviews?

Übe mit unseren interaktiven Simulatoren, Flashcards und technischen Tests.

Wie funktioniert die Goroutine-Leak-Erkennung in Go 1.26?

Erwartete Antwort: Go 1.26 fuehrt einen experimentellen goroutineleak-Profiltyp in runtime/pprof ein. Eine geleakte Goroutine ist eine, die an einem Concurrency-Primitiv (Channel, sync.Mutex, sync.Cond) blockiert und nicht mehr aufgeweckt werden kann. Die Runtime erkennt diese Leaks mithilfe des Garbage Collectors: Wenn Goroutine G an Primitiv P blockiert ist und P von keiner lauffaehigen Goroutine erreichbar ist, kann G niemals aufwachen.

func processWorkItems(ws []workItem) ([]workResult, error) {

ch := make(chan result)

for _, w := range ws {

go func() {

res, err := processWorkItem(w)

ch <- result{res, err} // goroutine blocks here if early return

}()

}

for range len(ws) {

r := <-ch

if r.err != nil {

return nil, r.err // remaining goroutines leak

}

}

return results, nil

}

// Enable detection: GOEXPERIMENT=goroutineleakprofile

// Endpoint: /debug/pprof/goroutineleakDie Erkennung nutzt die GC-Erreichbarkeitsanalyse und erfasst dadurch eine grosse Klasse von Leaks ohne manuelle Instrumentierung. Es wird erwartet, dass dieses Feature in Go 1.27 standardmaessig aktiviert wird.

Welche Sicherheitsverbesserungen bringt Go 1.26?

Erwartete Antwort: Zwei bemerkenswerte Sicherheitsverbesserungen:

Randomisierung der Heap-Basisadresse (64-Bit-Plattformen): Die Runtime randomisiert nun die Heap-Basisadresse beim Programmstart, was es Angreifern erschwert, Speicheradressen vorherzusagen, wenn Schwachstellen ueber cgo ausgenutzt werden. Dies stellt eine ASLR-aehnliche Verteidigung fuer den Go-Heap-Speicher dar. Die Funktion kann mit GOEXPERIMENT=norandomizedheapbase64 deaktiviert werden.

Post-Quanten-Kryptografie standardmaessig aktiviert: TLS-Verbindungen verwenden nun standardmaessig hybriden Schluesselaustausch (SecP256r1MLKEM768, SecP384r1MLKEM1024), der klassische Elliptic-Curve-Kryptografie mit ML-KEM (frueher CRYSTALS-Kyber) fuer Quantenresistenz kombiniert. Das Paket crypto/mlkem wurde ausserdem um rund 18% schneller bei der Kapselung und Entkapselung.

Welche Performance-Verbesserungen gibt es in der Standardbibliothek von Go 1.26?

Erwartete Antwort: Mehrere Standardbibliotheksfunktionen erhielten gezielte Optimierungen:

| Funktion | Verbesserung | Detail |

|----------|------------|--------|

| fmt.Errorf (ohne Format-Verben) | ca. 92% schneller | Unformatierte Aufrufe erreichen nun die Geschwindigkeit von errors.New |

| io.ReadAll | ca. 2x schneller, 50% weniger Speicher | Nutzt exponentielles Bufferwachstum statt linearem |

| crypto/mlkem | ca. 18% schneller | Optimierte Kapselung und Entkapselung |

| image/jpeg | Schneller, praeziser | Neue Encoder/Decoder-Implementierung |

Zusaetzlich erhielt bytes.Buffer eine Peek()-Methode, errors bekam eine generische AsType()-Funktion, und reflect erhielt Iterator-Methoden (Type.Fields(), Type.Methods(), Value.Fields()), die mit dem Range-over-Func-Muster von Go harmonieren.

Wie vereinfacht die neue Funktion errors.AsType die Fehlerbehandlung?

Erwartete Antwort: errors.AsType[T]() ist eine generische Alternative zu errors.As(). Sie eliminiert die Notwendigkeit, vor dem Aufruf von As eine Zielvariable zu deklarieren, und reduziert so den Boilerplate-Code.

// Before Go 1.26: two-step process

var pathErr *os.PathError

if errors.As(err, &pathErr) {

log.Printf("path error on %s: %v", pathErr.Path, pathErr.Err)

}

// Go 1.26: single expression

if pathErr, ok := errors.AsType[*os.PathError](err); ok {

log.Printf("path error on %s: %v", pathErr.Path, pathErr.Err)

}Die generische Version ist zur Kompilierzeit typsicher und liest sich in bedingten Ketten natuerlicher.

Bereit für deine Go-Interviews?

Übe mit unseren interaktiven Simulatoren, Flashcards und technischen Tests.

Fazit

- Der Green Tea GC scannt 8-KiB-Speicherseiten anstatt Pointern zu folgen und erzielt eine Reduktion des GC-Overheads um 10-40% ohne jegliche Codeanpassungen

- Stack-allozierte Slice-Backing-Stores eliminieren 3+ Startup-Heap-Allokationen bei Append-Schleifen und kopieren Daten nur einmal an Escape-Punkten auf den Heap

- Das ueberarbeitete

go fix-Tool wendet Dutzende von Modernizern an, die auf demgo vet-Analyse-Framework basieren, mit garantiert null Verhaltensaenderungen new()akzeptiert nun Ausdruecke als Argument und macht Pointer-Hilfsfunktionen ueberfluessig- Selbstreferenzielle generische Typconstraints ermoeglichen F-bounded-Polymorphism-Muster

- Die experimentelle Goroutine-Leak-Erkennung nutzt GC-Erreichbarkeitsanalysen, um dauerhaft blockierte Goroutinen zu finden

fmt.Errorfohne Format-Verben ist nun 92% schneller, undio.ReadAllverbraucht 50% weniger Speicher- Hybrider Post-Quanten-Schluesselaustausch ist standardmaessig bei TLS-Verbindungen aktiviert

Die Vorbereitung auf Go-Interviewfragen profitiert vom Verstaendnis dieser Runtime-Aenderungen. Der Go-Concurrency-Leitfaden behandelt grundlegende Goroutine-Muster, die das hier besprochene Leak-Detection-Feature ergaenzen.

Fang an zu üben!

Teste dein Wissen mit unseren Interview-Simulatoren und technischen Tests.

Tags

Teilen

Verwandte Artikel

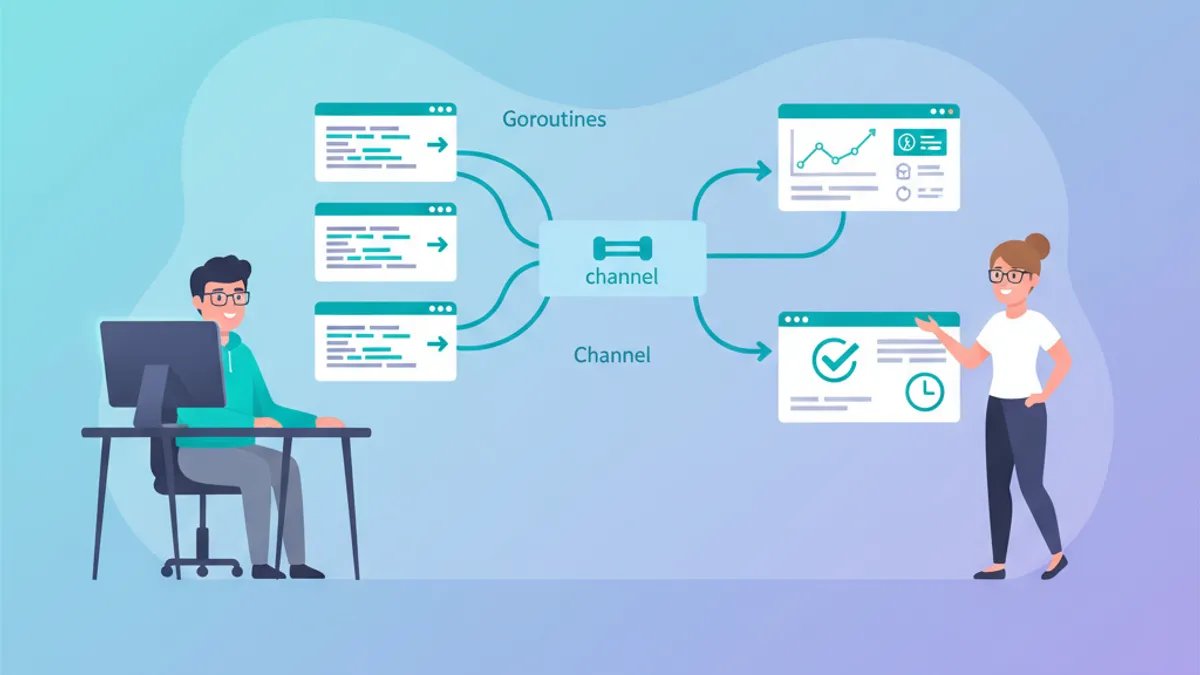

Go-Interview: Goroutines, Channels und Concurrency-Patterns meistern

Go-Interviewfragen zu Goroutines, Channels und Concurrency mit Codebeispielen. Fan-Out/Fan-In, Worker Pools, Race Conditions und Context-Patterns.

Top 25 Go-Interviewfragen: vollständiger Entwicklerleitfaden

Go-Interviews meistern mit den 25 häufigsten Fragen. Goroutinen, Channels, Schnittstellen und Concurrency-Muster mit Codebeispielen.

Nebenläufigkeit in Go: Goroutinen und Kanäle - Vollständiger Leitfaden

Beherrschen Sie die Nebenläufigkeit in Go mit Goroutinen und Kanälen. Fortgeschrittene Muster, Synchronisation, select-Anweisungen und Best Practices mit detaillierten Codebeispielen.