Ruby on Rails 8: Novità e Guida Completa alla Migrazione 2026

Rails 8 introduce la Solid Trifecta, l'autenticazione nativa, Kamal 2 e Propshaft. Guida completa con esempi di codice e passaggi per la migrazione da Rails 7.

Scopri i nostri articoli di esperti per padroneggiare le tecnologie e superare i colloqui tecnici

Rails 8 introduce la Solid Trifecta, l'autenticazione nativa, Kamal 2 e Propshaft. Guida completa con esempi di codice e passaggi per la migrazione da Rails 7.

Guida completa ai middleware di Laravel con esempi pratici su autenticazione, rate limiting con throttle, creazione di middleware personalizzati e pattern avanzati per applicazioni in produzione.

Ottimizzazione delle prestazioni di EF Core 10 con AsNoTracking, split query, operazioni batch, il nuovo operatore LeftJoin e filtri di query con nome. Guida pratica con esempi C# per applicazioni .NET 10 in produzione.

Guida completa alle domande sui colloqui Terraform con gestione dello state, progettazione di moduli, pipeline CI/CD e concetti avanzati di IaC per il 2026.

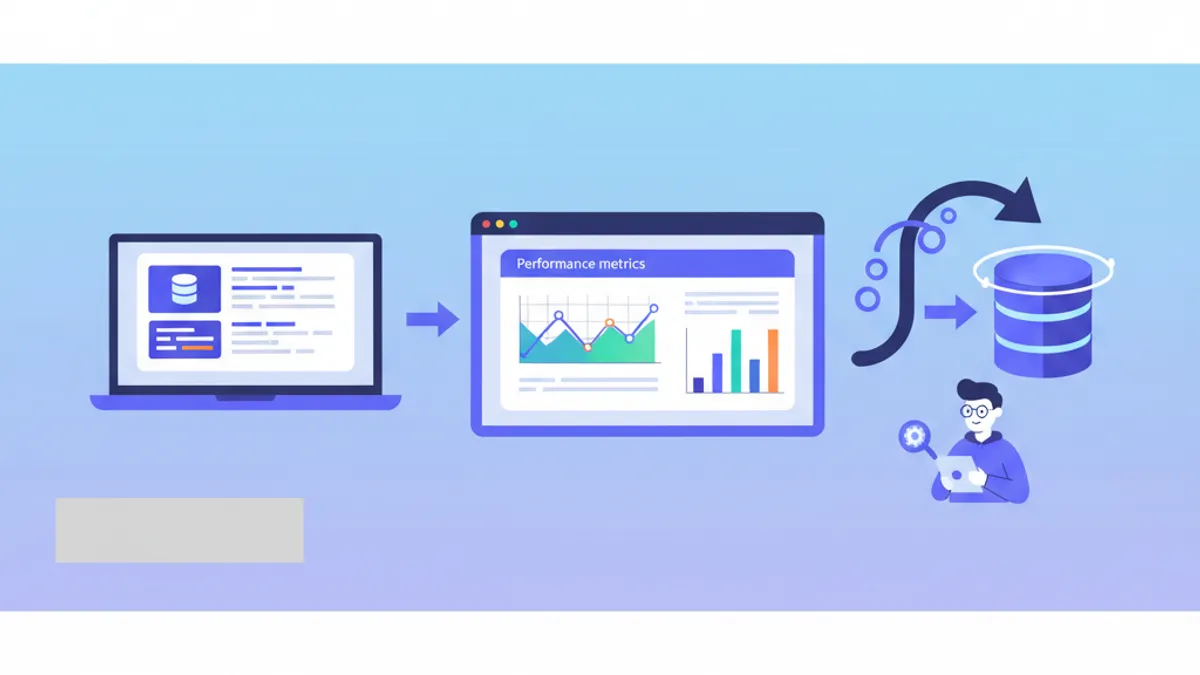

Confronto ETL vs ELT per le data pipeline moderne. Differenze architetturali, compromessi su prestazioni e costi, e quando utilizzare ciascun approccio con Snowflake, BigQuery e dbt nel 2026.

Guida pratica alla costruzione di pipeline dati ETL con PySpark e Spark 4.0: dalla lettura dei dati grezzi alla scrittura ottimizzata, passando per trasformazioni, join, aggregazioni e la nuova Python Data Source API.